La inteligencia artificial tiene el poder de impulsar la innovación y moldear tanto la industria como el gobierno. Con el avance constante y la creciente adopción de las tecnologías de IA, los gobiernos, las empresas y el público en general evalúan cada vez más los riesgos y recompensas de su uso. Pero dado el ritmo de desarrollo tan rápido y la novedad de estas herramientas, es necesario que se ponga al día una legislación integral. En respuesta a la creciente preocupación acerca de las IA sin regulación, las potencias mundiales, como la UE y EE. UU. Han empezado a dar pasos para implementar leyes sobre IA. La UE ha introducido un marco centralizado para proteger los derechos fundamentales, asegurarse de que el uso de IA sea fiable y guiar la innovación de acuerdo con los valores europeos. Por el contrario, EE. UU. no implementó una única ley federal sobre IA y se decidió por un enfoque estatal más fragmentado.

Este estudio comprueba el estado actual de las leyes sobre IA en EE. UU., destacando tanto la legislación ya promulgada como las leyes pendientes y compara estos esfuerzos con el enfoque de la UE.

Estado actual de la legislación sobre IA en EE. UU.

La legislación sobre IA a nivel estatal en los Estado Unidos evoluciona rápidamente, ya que los legisladores de todo el país introducen y debaten constantemente nuevas leyes que regulan una gran variedad de aplicaciones de IA. Las preocupaciones principales son la privacidad, la responsabilidad, la sustitución de los trabajadores por IA y el uso ético de la IA en áreas sensibles como la aplicación de la ley, la educación y la sanidad.

Dado que aún no se ha promulgado una ley federal integral sobre IA, el paisaje legal está definido en gran medida por los esfuerzos realizados a nivel estatal. Los 50 estados han introducido legislación relacionada con la IA durante 2025, pero el número y el foco de estas leyes son muy variadas. Esto refleja las distintas prioridades regionales y las preocupaciones sobre el impacto de la IA en la sociedad. Mientras las agencias federales trabajan en estándares y directrices más amplios para la IA, la mayoría de los cambios legislativos de EE. UU. En la actualidad emanan de los estados individuales.

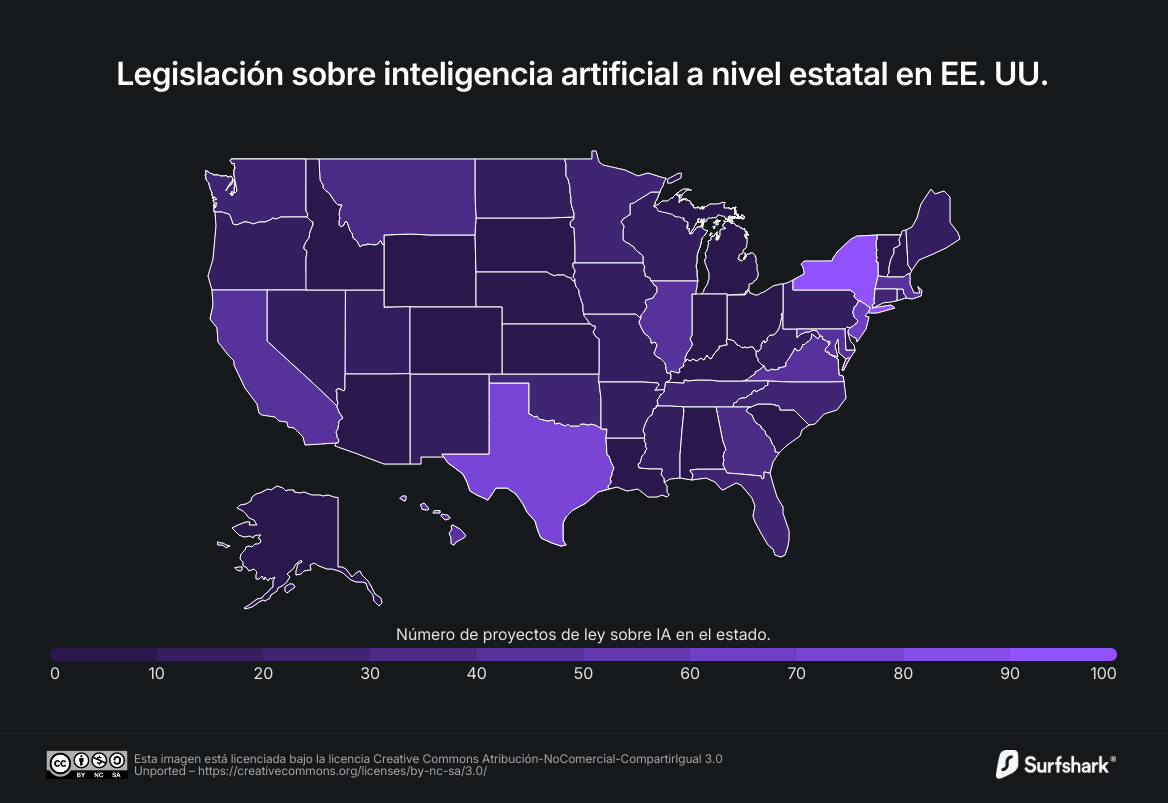

Los estados más activos en términos de legislación relacionada con la IA son Nueva York (106 leyes), Texas (72), Nueva Jersey (67), Massachusetts (49), Virginia (46), Illinois (45), California (44), Maryland (43), Hawaii (40), Georgia (32) y Montana (32). Estos estados han introducido el mayor número de leyes relacionadas con la IA, lo que indica un amplio interés legislativo en varios aspectos de la inteligencia artificial, que incluyen la privacidad, la ética, las implicaciones para la masa laboral y la seguridad pública.

En contraste, estados como Iowa, Wisconsin, Kentucky, Vermont, Alabama y otros 15 han promulgado 10 leyes o menos. Esto sugiere un enfoque más cauto, posiblemente reflejo de la estrategia de observar cómo se desarrollan los reglamentos iniciales en otras jurisdicciones o de centrarse solo en problemas específicos de mayor prioridad.

Diecinueve estados, incluidos Connecticut, Florida, Carolina del norte y Tennessee entran en la mitad de la tabla, con entre 11 y 24 leyes promulgadas.

Entre los territorios asociados de EE. UU., Puerto Rico lleva la delantera con 6 leyes, mientras que el distrito de Columbia, Guam y las Islas Vírgenes han promulgado una sola ley cada una.

La variación de actividad legislativa entre estados y territorios refleja las diferencias de prioridades regionales, recursos disponibles y el impacto que se percibe localmente. Los estados como Nueva York y Texas, con mayor población o importantes sectores tecnológicos, tienen mayor probabilidad de proponer un mayor volumen de legislación, seguramente debido a una mayor exposición a las oportunidades y los desafíos que representa la inteligencia artificial.

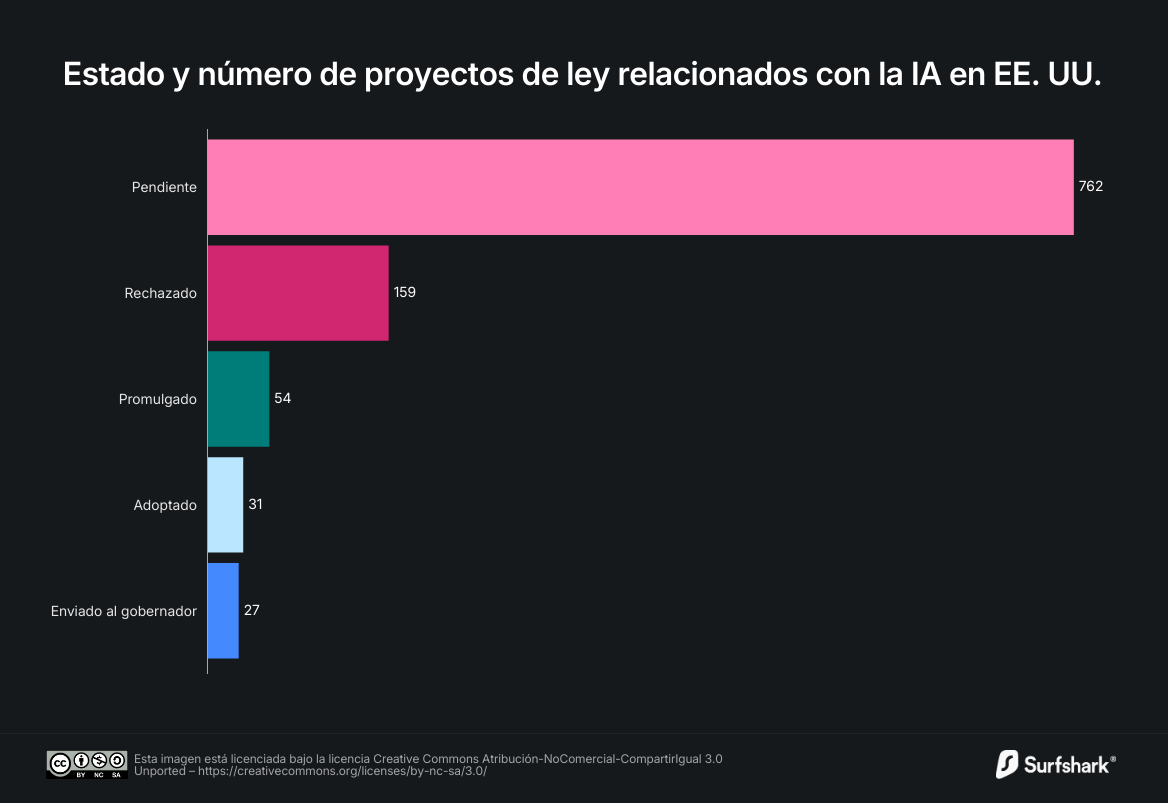

Por todo Estados Unidos, la mayoría de las leyes relacionadas con la IA se están revisando, con un total de 762 leyes pendientes de los legisladores estatales en la actualidad. Hasta el momento, 54 proyectos se han promulgado oficialmente como ley y 31 se han adoptado formalmente a través de otros procesos legislativos. Sin embargo, un gran número (159) no han podido seguir adelante y se han rechazado o retirado. Además, 27 proyectos han superado la fase legislativa y esperan aprobación o veto de los gobernadores estatales. Este patrón sugiere que la legislación sobre IA es muy activa y en constante evolución, la mayoría de las propuestas siguen en consideración y solo una pequeña fracción ha pasado a ley de momento.

Hemos seleccionado algunos ejemplos para comprender mejor qué tipo de leyes se están priorizando, Estos ejemplos incluyen leyes promulgadas, adoptadas y enviadas a los gobernadores o fallidas.

Promulgadas:

- Nueva York, Utah y Arkansas aprobaron proyectos de ley creados para proteger individuos cuyas fotografías, voces o parecidos se reproduzcan a través de inteligencia artificial;

- Dakota del Norte criminaliza el uso de robots con IA para acosar u hostigar a nadie, tratando tal conducto como acoso;

- La ley de Arkansas clarificó que la persona que proporciona la entrada o directiva para una herramienta de inteligencia artificial generativa es el propietario del contenido generado;

- Virginia promulgó varias leyes relacionadas con la salud, lo que incluye menciones según las cuales requiere que todos los hospitales, residencias de ancianos y centros de enfermería certificados para establecer e implementar políticas que determinan cómo pueden acceder y utilizar los pacientes un «asistente personal inteligente» (como asistentes digitales o virtuales dirigidas por inteligencia artificial y procesamiento de lenguaje natural) al recibir cuidados.

Adoptadas:

- Nueva Jersey adoptó una ley que pretende asegurar que los empleados y evaluadores de una empresa de IA puedan denunciar de los riesgos de forma segura y responsable en los sistemas de IA generativa;

- La mayoría de las leyes adoptadas (18 de 31) proporcionan honores y reconocimiento para las contribuciones en el campo de la IA. Se adoptaron tres leyes para crear comités para estudiar el uso presente y futuro de la IA y la mayoría de las proposiciones de ley restantes solo mencionan brevemente la IA y no están relacionados con los temas principales de la legislación.

Enviadas al gobernador:

- En Tennessee, las víctimas de imágenes hechas con deepfake pueden demandar por los daños o recibir hasta 150 000 dólares en indemnización por daños y perjuicios;

- Explícitamente permite a las agencias estatales de Indiana usar software de inteligencia artificial (IA) al preparar las declaraciones necesarias y las proyecciones de presupuestos;

- Maryland añade una vigilancia estricta y requisitos de seguridad para el paciente en el uso de IA en la revisión de utilización de seguros médicos, asegurándose de que las decisiones de la IA se individualicen, cumplan con los reglamentos y no puedan sustituir el juicio clínico de un humano;

- Maryland: Evalúa el uso de software que usa inteligencia artificial (IA) para identificar armas mortales y explorar cómo puede integrarse con efectividad este software de IA con cámaras de seguridad y otras tecnologías de seguridad escolar.

Fracasadas:

- Maryland no consiguió aprobar una proposición de ley que habría hecho que cualquier persona que intencionadamente, a sabiendas, o por negligencia diseñe o cree software de inteligencia artificial capaz de causar heridas físicas o la muerte, sea responsable por los daños y esté sujeto a penalizaciones civiles si el software se usa para causar dichos daños. Las penalizaciones podrían haber incluido penas de hasta 20 años de prisión, una multa de hasta 100 000 dólares, o ambas;

- La ley fallida de Montana propone nuevas normas que restringen cómo las empresas de seguros sanitarios utilicen la inteligencia artificial (IA), los algoritmos o herramientas de software similares para su uso en revisión o gestión (p.ej. Aprobar, retrasar o negar las reclamaciones de seguros sanitarios según su necesidad médica);

- Connecticut no fue capaz de aprobar una proposición de ley que prohíbe a los propietarios de propiedades de alquiler residencial utilizar algoritmos de tarificación y los datos sensibles de la competencia para fijar los precios del alquiler. Otras tres proposiciones de ley similares fracasaron en Nuevo México, New Hampshire y Maryland.

Estado actual de la legislación de IA en la UE

unificado en cuanto a su regulación. En contraste con los esfuerzos estatales fragmentados vistos en EE. UU., la UE introdujo la Ley de Inteligencia Artificial (Ley de IA) en 2024. Es el primer marco legal integral diseñado específicamente para dirigir el desarrollo, el despliegue y el uso de tecnologías de IA.

La Ley de IA busca asegurar que los sistemas de IA utilizados dentro de la UE son seguros, transparentes y respetan los derechos fundamentales. Clasifica las aplicaciones de IA según el nivel de riesgo, creando unos requisitos más estrictos en los determinados como de alto riesgo. Al igual que hizo el Reglamento General de Protección de Datos (GDPR) por la privacidad de los datos, esta legislación debería influir en toda la gobernanza de la IA de forma global.

La aplicación de la Ley de IA se llevará a cabo tanto a nivel nacional como a nivel de la UE. Cada uno de los miembros de la UE deberá nombrar una o varias autoridades supervisoras para vigilar la aplicación dentro de su jurisdicción. Estas autoridades supervisarán la implementación de la Ley de IA, realizarán auditorías, investigarán las violaciones e impondrán penalizaciones cuando sea necesario. A nivel de la UE, la Junta de Inteligencia Artificial coordinará los esfuerzos nacionales, promoverá una aplicación coherente de la ley y proporcionará su guía en los casos complejos¹.

El incumplimiento de la Ley de IA puede resultar en importantes penalizaciones económicas. Según el artículo 99: La penalizaciones, por infracciones del Artículo 5, que prohíbe las prácticas de IA que conllevan riesgos inaceptables, pueden llevar a multas de hasta 35 millones de euros o hasta un 7 % de la facturación anual del período financiero anterior, la suma más alta.

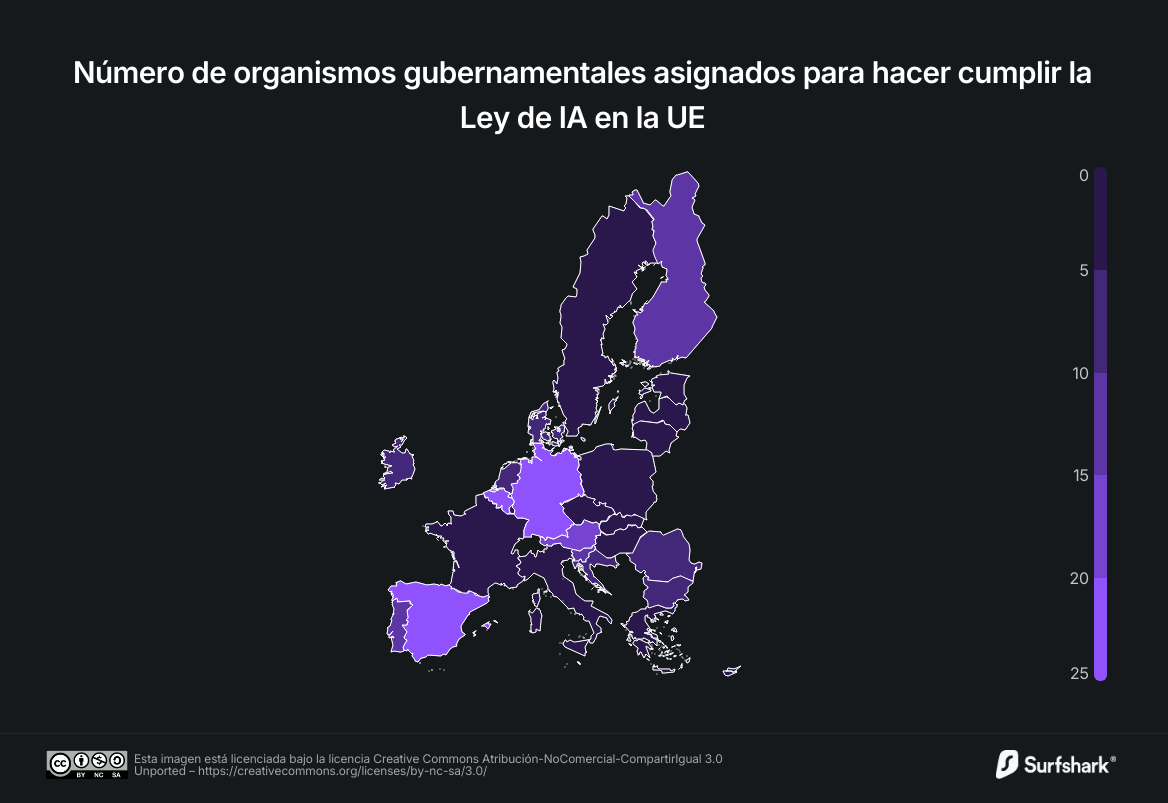

Los países de la UE utilizan varios enfoques al asignar órganos rectores para aplicar la Ley de IA. Países como Bélgica, España. Alemania y Austria han adoptado un enfoque descentralizado, asignando varios órganos rectores distintos (entre 19 y 26). Por el contrario, naciones como Francia, Chipre, Estonia, Luxemburgo, República Checa, Eslovaquia y Letonia han optado por un modelo más centralizado, con pocos órganos rectores para vigilar la IA (entre 1 y 3).

Lo interesante es que este patrón no se correlaciona necesariamente con el tamaño o la población del país. Por ejemplo, países más pequeños, como Malta, Finlandia o Eslovenia, han asignado 10 órganos rectores, superando a otros países más grandes como Francia. En particular, Hungría e Italia son los únicos países de la UE que no tienen órganos de aplicación en la actualidad.

En general, 22 de los 27 países de la UE han asignado hasta 10 órganos rectores, mientras que otros cinco países entran en el rango superior, entre 14 y 26. Esta diversidad destaca la ausencia de un enfoque estandarizado para la aplicación de la Ley de IA en toda la UE, ya que los países adaptan los marcos regulatorios para que se adapten a sus contextos y prioridades nacionales.

Diferencias estructurales: la legislación sobre IA de EE. UU. Contra la Ley de IA de la UE

En la Unión Europea, la legislación de IA está caracterizada por un marco centralizado establecido a nivel de la Unión. La próxima Ley de IA ejemplifica este modelo, proporcionando un estándar ilegal unificado que será de aplicación directa en todos los países miembros. La aplicación y supervisión se delegan a las autoridades públicas asignadas dentro de cada país miembro. Este enfoque vertical está diseñado para minimizar la fragmentación legal, armonizar la supervisión de IA y proporcionar reglas claras y coherentes para los desarrolladores y usuarios en el mercado interno.

Por el contrario, loas Estados Unidos han adoptado un enfoque muy descentralizado para la legislación sobre IA. La ausencia de una ley de IA federal integral ha llevado a un collage de iniciativas a nivel estatal. Cada estado puede proponer, promulgar o rechazar sus proposiciones de ley relacionadas con la IA, a menudo centradas en distintos sectores o preocupaciones políticas. Esto es evidente en la actividad legislativa muy variable en las distintas jurisdicciones de EE. UU., con estados que proponen varias leyes y otras que tienen poca o ninguna legislación. El resultado es un paisaje regulador diverso con una cobertura y unos estándares incoherentes, que reflejan las prioridades locales y voluntad política, en lugar de una estrategia nacional coordinada.

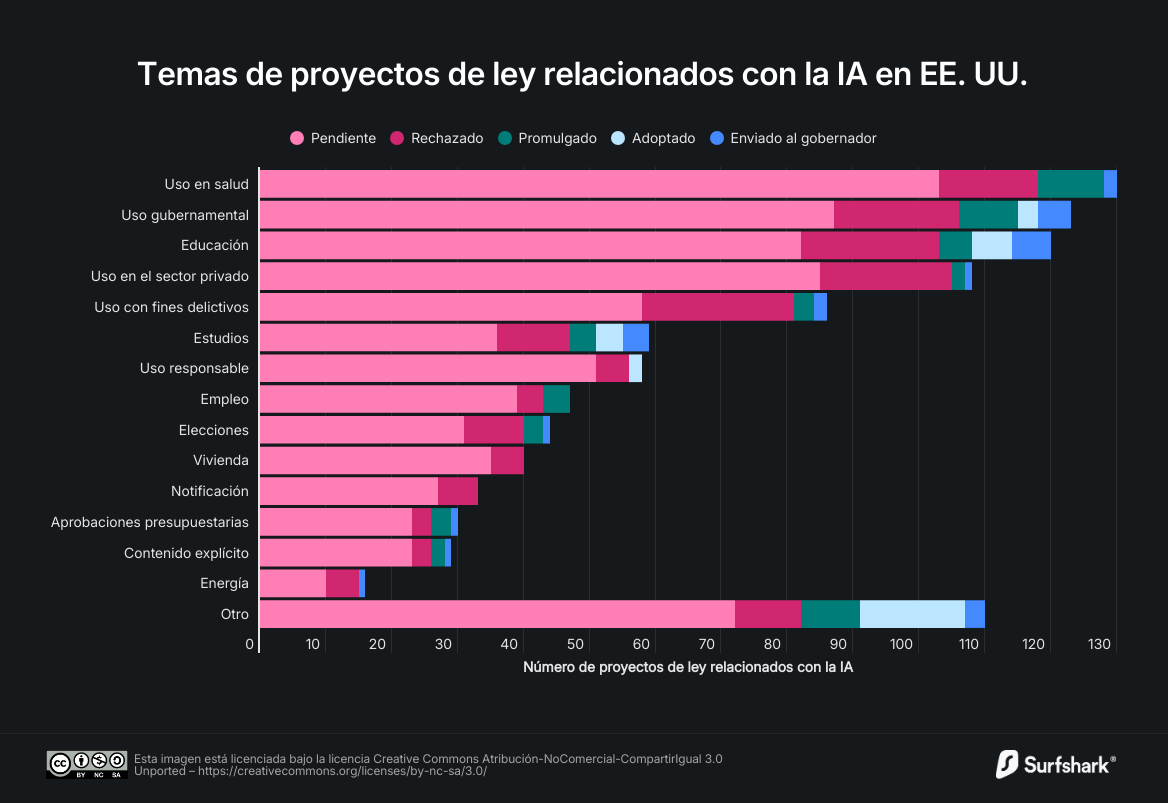

Las cinco áreas clave con mayor número de proposiciones de ley relacionadas con la IA en EE. UU, son el uso sanitario (12,6 % de ellas), uso gubernamental (11,9 %), uso en el sector privado (10,5 %) y uso criminal (8,3 %). Juntas, estas categorías representan la mayoría de la legislación de IA. Otros temas, que incluyen las elecciones, el empleo, el uso responsable de la IA y otros problemas adicionales que representan el 45,1 % de las proposiciones de ley.

Aunque la mayoría de las proposiciones de ley, una media del 74 %, siguen pendientes, ciertos temas muestran una mayor tasa de fracaso que otros. El sector energético tiene la mayor tasa de fracaso, con un 31 % de proposiciones de ley fracasadas y la mayoría de las otras pendientes. Las proposiciones de ley relacionadas con el uso criminal también muestran una alta tasa de fracaso, con 23 proposiciones de ley ya rechazadas y solo 2 elevadas a estado de ley.

Los temas con menor porcentaje de proposiciones de ley pendientes incluyen los estudios, en que el 64 % de las proposiciones de ley ya han superado la fase pendiente, seguidos por la energía (60 %), el uso criminal (48 %), la educación (46 %), las elecciones (42 %) y el uso gubernamental (41 %). Esto sugiere que estos sectores son prioritarios en el procesamiento legislativo. Por el contrario, los sectores con menor prioridad parecen ser el uso responsable (14 % de las proposiciones de ley han superado la fase pendiente), el alojamiento (14 %) y el empleo (21 %).

Foco y prioridades en la UE

La Ley de IA de la UE ejemplifica una estrategia de regulación basada en los riesgos, donde los sistemas de IA se clasifican y rigen según los riesgos potenciales que suponen para la sociedad, en particular respecto de la seguridad, la privacidad, la no discriminación y las libertades personales².

Las prioridades clave incluyen:

- Proteger los derechos fundamentales: la legislación enfatiza la protección de los individuos, en particular en áreas sensibles, como el reconocimiento, la supervisión y la toma de decisiones de alto impacto;

- Gestión de riesgos: sistemas de IA de riesgo alto, como los utilizados en infraestructuras críticas, cuidado sanitario, educación y aplicación de la ley, están sujetos a estrictos requisitos de transparencia, responsabilidad y supervisión humana;

- Transparencia y responsabilidad: la UE prioriza hacer que los sistemas de IA sean explicables y asegurar una línea clara de responsabilidad a lo largo de los procesos de desarrollo y despliegue;

- Promover la innovación: además de la regulación, la UE quiere crear un entorno de apoyo para la innovación ética en IA, proporcionando entornos regulatorios controlados y guía para las empresas y los investigadores;

- Armonización entre estados miembros: estableciendo estándares en toda la UE y una red coordinada de autoridades supervisoras, la UA busca prevenir los enfoques nacionales fragmentados y crear un solo mercado fiable de IA.

Metodología y fuentes

Los datos, incluidos los números de proposiciones de ley, estado de las proposiciones, los estados y el tema de la legislación sobre IA en EE. UU. se recogieron de la Conferencia Nacional sobre Legislaturas Estatales. Para la UE, las prioridades de diseño de las autoridades supervisoras nacionales se identificaron a partir de la Ley de IA. Los datos se analizaron para comparar el estado actual de la legislación de IA en EE. UU. Y la UE, con atención particular a los distintos focos y prioridades de la legislación en cada región.

Para ver el material de investigación completo tras este estudio, visite este enlace.

Datos recogidos de:

NCSL. Artificial Intelligence 2025 Legislation.

Comisión Europea. Gobernanza y aplicación de la Ley de IA.

Referencias:

¹Comisión Europea. ¿Cómo se hará cumplir el Reglamento de Inteligencia Artificial?

²Comisión Europea. Enfoque europeo de la inteligencia artificial.

PREGUNTAS FRECUENTES

¿Cuál es el estándar de la Ley de IA en la UE?

La Ley de IA es el primer marco legal integral para la inteligencia artificial, adoptado en 2024. Introduce reglas basadas en los riesgos para el desarrollo y uso de la IA, centrándose en la seguridad, la transparencia y los derechos fundamentales. La Ley es parte de una estrategia mayor de la UE y apoya la innovación en IA. Descubre más acerca de la legislación de IA de la UE en la página Ley de IA de la UE.

¿La Ley de IA de la UE es de aplicación en EE. UU.?

No, la Ley de IA de la UE no se aplica en EE. UU., ya que no forma parte de la Unión Europea.

¿Hay alguna regulación sobre IA en EE. UU.?

Sí, pero las regulaciones varían según el estado, ya que no existe una ley federal integral. La mayoría de los esfuerzos surgen de los estados y tienen distinto foco y alcance. Descubre más acerca de las regulaciones de EE. UU. en la Artificial Intelligence 2025 Legislation.

¿La Ley de IA se ha aprobado?

En Estados Unidos, varios ya han promulgado leyes específicas sobre IA, pero sigue sin existir legislación federal integral. La mayoría de las proposiciones de ley siguen en proceso de revisión. Por el contrario, la Unión Europea adoptó formalmente la Ley de IA en 2024. Aunque la mayoría de los requisitos entrarán en efecto para la mitad de 2026, ciertas provisiones se pueden implementar más tarde o más temprano, dependiendo de los reglamentos.

¿Cuáles son las diferencias entre las legislaciones en EE. UU. y la UE?

Europa ha adoptado un enfoque unificado a través de la Ley de IA, que se aplicará de forma coherente en todos los estados miembros. Por el contrario, la legislación de IA en Estados Unidos se ha fragmentado, variando según el estado y moldeada por las prioridades locales y las agendas políticas, en lugar de tener una estrategia nacional coordinada.